Intelligence artificielle et imagerie médicale

L’Intelligence Artificielle permet d'améliorer l'imagerie médicale, toujours à la recherche de rendus visuels de meilleure qualité. Congatec nous explique ce qu'on peut aujourd'hui attendre de l’informatique embarquée dans cette optique.

Auteur : Zeljko Loncaric, ingénieur marketing chez Congatec

L’imagerie médicale a fait d’immenses progrès ces dernières années. C’est principalement dû à la numérisation de l’imagerie diagnostique, qui améliore la qualité des données et des images, ainsi qu’à la rapidité de mise à disposition des images. Avec l’introduction massive de l’intelligence artificielle (IA) et de l’apprentissage automatique (Machine learning) dans sa version "profonde" (Deep Learning), nous entrons dans une ère nouvelle. Par rapport aux systèmes classiques de diagnostic assisté par ordinateur, l’IA offre une plus grande autonomie. Elle permet d’accélérer le diagnostic, mais aussi de le rendre plus sûr et plus fiable, car les systèmes d’auto-apprentissage prennent mieux en compte les nouvelles situations que les systèmes statiques.

Des bénéfices avérés

Des études effectuées dans divers secteurs le montrent : les systèmes d’imagerie médicale basés sur l’IA se distinguent par leur fiabilité et leur rapidité. Par exemple, une équipe de l’Institut de Recherche Méthodiste de Houston a développé un logiciel IA qui a détecté un cancer du sein 30 fois plus rapidement que des médecins dans un échantillon de 500 mammographies. La précision a été de 99 %. Un tel système ne permettrait pas seulement de repérer plus facilement un cancer du sein ; il serait aussi plus efficace pour la détection des faux positifs, évitant ainsi les biopsies inutiles, pour un meilleur confort du patient[i]. Une autre équipe de recherche s’est penchée sur le diagnostic du cancer de la peau. En s’appuyant sur des photos, le système a été capable d’identifier un cancer de la peau aussi sûrement qu’un dermatologue[ii]. Un troisième projet de l’hôpital Mount Sinai à New York a pu prévoir un cancer du foie avec la même précision qu’un oncologue. Au cours de cette étude, les scientifiques ont découvert que le système pourrait être utilisé aussi dans le futur pour détecter la schizophrénie ou autres maladies mentales chez un patient[iii].

Une adoption massive s'impose

L’IA et l’apprentissage profond ont déjà prouvé qu’ils étaient des outils précieux pour améliorer la détection précoce, le diagnostic et le traitement de nombreuses maladies graves. Si cette intelligence était aujourd'hui disponible pour chaque médecin via l’imagerie médicale, non seulement de nombreuses vies pourraient être sauvées mais les traitements inadaptés et les chirurgies inutiles pourraient être évités. Les médecins disposeraient alors d'une quantité d'informations sans précédent pour les soutenir automatiquement avec le plus haut niveau d'expertise en matière de diagnostic et de traitement. De cette façon, on pourrait même identifier les plus petits et les plus rares indicateurs, qu’un médecin pourrait même ne jamais rencontrer sur plusieurs dizaines d’années de pratique. Une étude menée par PWC, une société de consultants professionnels, montre que l’utilisation généralisée de l’IA dans toute l’Europe pourrait réduire les coûts de santé et de suivi d’au moins 200 Md€ en dix ans[iv].

Passer à l’IA est une tâche relativement simple en utilisant les modules de Congatec à base d'AMD, car les designs COM Express existants à base d'autres processeurs peuvent être facilement modifiés.

La question se pose donc ainsi : quelles sont les plates-formes technologiques qui permettront une adoption massive de l'IA ?

Commençons par la bonne nouvelle : les plus récentes plates-formes informatiques embarquées répondent à toutes les exigences nécessaires en termes de puissance de calcul, d’efficacité énergétique et de programmabilité pour intégrer une IA haute performance dans chaque dispositif à ultra-sons, chaque station de radiologie et chaque PC médical dans le cabinet du médecin.

Maintenant, on peut se demander comment l’intelligence artificielle de tous les datacenters rentre dans des plates-formes embarquées basse consommation. La vérité, c'est qu’elle n’y entre pas. Elle n’a pas à y entrer ; car l’apprentissage profond, très gourmand en ressources, est opéré au sein des serveurs, du moins pour le moment. Ces équipements médicaux utilisent simplement l’intelligence située dans les datacenters. Ce processus s’appelle l'inférence.

Un apprentissage profond opéré au niveau du datacenter

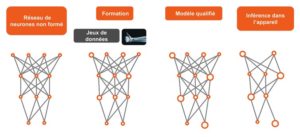

Le processus est presque toujours le même pour tous les types de tâches. Un ensemble de plusieurs unités de calcul - pour la plupart des GPGPU (General Purpose Graphics Units) - est intégré dans un réseau neuronal DNN (deep neural network). Ce réseau d’apprentissage profond doit être "formé". En ce qui concerne l’imagerie de diagnostic, il peut s'agir de traiter des images de radiologie pour une détection précoce d'un cancer du sein ou du foie, voire des photos ordinaires de la peau pour former le système à reconnaître le cancer de la peau.

Schéma illustrant l’apprentissage profond dans le datacenter et l'intelligence localisée dans le DM.

La quantité de données d'imagerie nécessaire est immense. On parle de 130 000 à 700 000 images de diagnostics positifs et négatifs pour les projets de recherche concrets. Munis de ces informations, les réseaux de neurones développent des paramètres et des routines basés sur des algorithmes spécifiques, avec une précision qui n’est jamais inférieure à celle d’un médecin spécialiste expérimenté.

Intégrer l’intelligence dans des ordinateurs embarqués

Comme on l'a dit, cette intelligence se trouve, pour l'instant, dans le cloud ou dans un datacenter, mais pas encore dans le dispositif médical lui-même. C’est là qu’entre en scène l’inférence. C’est le processus utilisé pour intégrer ce qui a été appris dans un matériel local. Pour que l’intelligence du réseau de neurones stocké dans le datacenter tienne dans un seul processeur, le logiciel doit être minimal. C’est pourquoi toutes les parties du réseau neuronal qui ne sont pas nécessaires après une formation réussie sont habituellement laissées de côté. Comme elles ne sont pas actives dans le processus de prise de décision, elles peuvent être abandonnées en toute sécurité. En outre, plusieurs couches de décision du réseau neuronal d’origine peuvent être intégrées dans une seule opération. Là encore, il n’y a aucun inconvénient puisque le système local n’a pas besoin d’auto-apprendre, même si cela serait tout à fait possible.

Il est clairement plus efficace de continuer à former le système délocalisé avec de nouvelles données puis d’amener les appareils locaux au niveau de connaissance atteint via des mises à jour logicielles régulières. C’est exactement la raison pour laquelle les interfaces IoT (internet des objets) médicales, qui connectent les DM dans le cloud et les serveurs des prestataires technologiques, sont indispensables au futur développement de ces technologies.

La bonne technologie de processeur

Si la décentralisation de l'apprentissage fait baisser notablement les exigences en termes de performances informatiques dans le DM, la puissance de traitement nécessaire est encore très élevée pour un seul processeur. De plus, l’architecture informatique locale et celle du data center doivent être comparables pour diminuer les coûts de portage du logiciel et des algorithmes. Avec les processeurs x86 classiques et des GPGPU puissantes, la dernière génération d'unités de traitement embarquées offre exactement la bonne dose de puissance de calcul variable pour l’IA et l'apprentissage automatique.

Les besoins énergétiques sont si faibles que ces fonctions peuvent, déjà aujourd'hui, être intégrées dans presque tous les domaines d’applications du traitement d’images. Cela s'étend des machines à rayons X mobiles sans ventilateur jusqu’aux appareils de stockage annexes pour les RIS (systèmes d’informations radiologiques) et les PACS (systèmes de communication et d’archivage d’images).

AMD Ryzen Embedded V1000 pour dispositifs médicaux

Grâce à l’augmentation significative de ses performances graphiques et de calculs, le nouveau processeur AMD Ryzen Embeded V-Series est particulièrement adapté à ce type de tâche. Avec une puissance de calcul de 3,6 TFLOPS fournie par un CPU polyvalent associé à un puissant GPGPU, il offre les performances modulables qu’on pouvait atteindre il y a quelques années seulement avec des systèmes consommant quelques centaines de watts. Aujourd’hui, cette puissance de calcul est disponible à partir de 15 W. On peut donc facilement l’intégrer dans des DM sans ventilateur, scellés hermétiquement, robustes et hautement hygiéniques pour les soins mobiles.

Ces processeurs embarqués AMD fournissent également un support logiciel complet pour des outils et infrastructures comme TensorFLow, Caffe et Keras qui sont requis pour introduire rapidement et à grande échelle l’IA et l’apprentissage profond. Sur https://gpuopen.com/professional-compute/, les développeurs peuvent également trouver un large choix d’outils logiciels et d’environnements de programmation pour les applications d’apprentissage profond et d’IA, comme la fameuse plate-forme open source ROCm pour les applications GPGPU.

Option de conception de serveur embarqué haut de gamme

Les systèmes haut de gamme comme les serveurs médicaux "dorsaux" qui nécessitent beaucoup plus de puissance que n’offrent les processeurs AMD Ryzen Embedded V1000, peuvent intégrer les nouveaux processeurs AMD EPYC Embedded 3000. Avec une disponibilité de 10 ans, jusqu’à 16 cœurs, une interface 10 Gigabit Ethernet et jusqu’à 64 voies PCIe pour de nombreuses unités de traitement parallèle supplémentaires, c’est une plate-forme adaptée à l’environnement médical.

Selon les demandes des clients, congatec prévoit de proposer ces processeurs également sur modules COM Express, avec l’objectif ultime de développer un nouveau brochage pour serveur embarqué haut de gamme pour le COM Express. Les cartes embarquées entièrement personnalisées seront une option alternative.

Le concept d'open source est essentiel pour s’assurer que les OEM ne dépendent pas d’une solution propriétaire. Cela comprend l’outil HIPfy, qui permet de convertir les applications CUDA propriétaires en applications portables HIP C++, et les rendre indépendantes du matériel. En accédant à un tel écosystème, l’apprentissage profond et l’IA sont comparativement faciles à mettre en œuvre et ne sont plus réservés à des géants de l’informatique comme Google, Apple, Microsoft et Facebook. Même les développeurs d’applications mobiles ont commencé la mise en œuvre d’apprentissage profond et d’inférences locales dans des applications concrètes, comme l’appli Not Hotdog qui reconnait les différents hot dogs dans les photos des téléphones mobiles avec une haute fiabilité – un exemple concret qui montre que l’IA est arrivée dans le secteur privé.

Rapidité de conception avec les modules COM

Maintenant, il reste une question : comment les fabricants de dispositifs médicaux vont-ils concevoir ces facilitateurs d’IA dans les appareils d’imagerie médicale aussi rapidement et efficacement que possible ? L’un des moyens les plus efficaces est l’utilisation de systèmes COM (Computer-on-Modules) standardisés. L’approche modulaire dissocie le dispositif médical de la technologie processeur. De cette façon, les fabricants disposent d’une feuille de route stable pour leurs produits, assurant une disponibilité à long terme et une ré-utilisation efficace des efforts de développement fournis.

En échangeant simplement les modules, de nouvelles classes de performances peuvent être intégrées dans les designs existants, pour que les OEM puissent facilement étendre les fonctionnalités de leurs projets avec ces fonctions innovantes. Le standard de module principal est le COM Express et il est déjà utilisé dans de nombreux dispositifs médicaux. Les OEM disposent ainsi d’une approche plug-and-play pour rendre leur matériel médical compatible IA, en changeant simplement de modules.

La carte-mère conga-IT6 mini-ITX peut être équipée du nouveau module puis insérée dans tout dispositif médical utilisant le standard ATX.

Congatec a déjà testé la rapidité de cette opération d'échange sur plusieurs designs de systèmes utilisant le nouveau module conga-TR4 avec les processeurs AMD Ryzen Embedded V1000. Pour migrer le module sur un système existant équipé d’un autre module COM Express Type 6, les développeurs d’une société partenaire avaient besoin du même temps pour équiper le système d’un hardware qui avait déjà été évalué. L’installation du logiciel nécessitait aussi uniquement les installations habituelles. Grâce à l’API standard, qui est la même pour tous les modules congatec, aucune programmation matérielle supplémentaire n’est requise. Conséquence : le contrôle GPIO est le même pour chaque module. Les concepteurs de systèmes en ont besoin, par exemple, pour mesurer les niveaux de luminosité ambiante de façon à ajuster automatiquement la luminosité de l’écran.

D'après Congatec, la migration vers les processeurs AMD ne constitue pas un défi avec les modules que l'entreprise propose, mais un gros plus pour les systèmes qui mettront en œuvre l’IA à l’avenir.

Twitter

Twitter LinkedIn

LinkedIn